代码写好如何做实验

代码写好之后,科学开展实验是验证程序价值的关键步骤。完整的代码实验流程包括明确目标与假设、构建可重复环境、设计对照方案、建立多维评价指标、规范数据采集与分析、进行多轮迭代优化以及撰写可复现实验报告。通过控制变量与量化指标,可以客观评估代码性能与质量。未来代码实验将更加自动化和体系化,成为软件开发流程中的重要组成部分。

Joshua Lee

Joshua Lee- 2026-04-09

控制变量如何写代码

控制变量在编程中的核心是固定无关因素、只改变单一关键变量,以保证测试和对比结果真实可靠。实现控制变量需要从参数隔离、数据一致、环境稳定和结果统计四个方面入手,并结合多次测试、固定随机种子和日志记录提升可重复性。在复杂系统中,控制变量逐渐从单一代码技巧升级为自动化工程方法,是提升软件质量和决策科学性的关键能力。

Joshua Lee

Joshua Lee- 2026-04-09

如何编写正交表代码

正交表代码的编写核心在于将多因素多水平实验设计转化为满足正交性的矩阵生成与水平映射逻辑,通过调用标准正交表或算法生成方法,可以在显著减少实验次数的前提下完成参数优化与主效应分析。文章系统讲解了正交表结构、代码实现步骤、结果分析方法及工程应用方式,并对比了正交设计与全排列的效率差异,帮助读者构建完整的正交实验编程思路与实践框架。

Elara

Elara- 2026-04-07

三盲实验如何应用在代码应用

三盲实验在代码应用中的核心作用是通过对开发者、测试者和评估者同时进行信息隔离,降低主观偏差,提升算法评测和系统验证的客观性与可信度。其适用于算法评估、A/B测试、安全测试和高风险系统验证场景,虽然实施成本较高,但能够增强实验可重复性和数据公信力。随着软件工程向科学实验化发展,三盲机制将在关键系统开发中发挥越来越重要的作用。

Elara

Elara- 2026-04-03

实验的代码如何做成实验

将实验代码转化为真正的实验,需要从单纯的程序运行升级为完整的实验体系建设,包括明确研究目标与假设、控制变量、构建可复现环境、设计对照实验、定义评价指标、自动化批量运行以及形成结构化报告。实验强调可验证性与可复现性,而不仅是代码是否能执行。只有通过标准化流程、数据记录和结果分析,代码才能成为具备科研或工程价值的实验成果。未来实验管理将更加系统化与自动化,可复现性将成为评价核心标准。

Joshua Lee

Joshua Lee- 2026-04-03

eprime如何敲代码

E-Prime敲代码的关键在于理解其对象层级结构与E-Basic脚本机制,通过图形化流程搭建实验框架,再利用Inline编写变量控制、条件判断与数据记录逻辑,实现精确的刺激呈现与反应采集。掌握变量声明、对象属性调用、数据输出方法以及调试技巧,是从入门到进阶的核心路径。随着实验复杂度提升,代码更多承担动态控制与逻辑扩展功能,真正重要的是将编程能力服务于实验设计与数据质量管理。

Rhett Bai

Rhett Bai- 2026-04-01

eprime如何编代码

E-Prime编程的核心在于理解其对象结构与时间轴逻辑,通过Session、Procedure、List和Object构建实验流程,并利用E-Basic脚本扩展复杂控制。基础实验可通过拖拽完成,进阶功能依赖变量控制与内嵌代码实现。掌握条件随机化、数据记录机制与时间优化策略,是构建高质量心理实验程序的关键。未来实验编程将向高精度与高扩展性方向发展,而E-Prime在严谨实验场景中仍具重要地位。

William Gu

William Gu- 2026-04-01

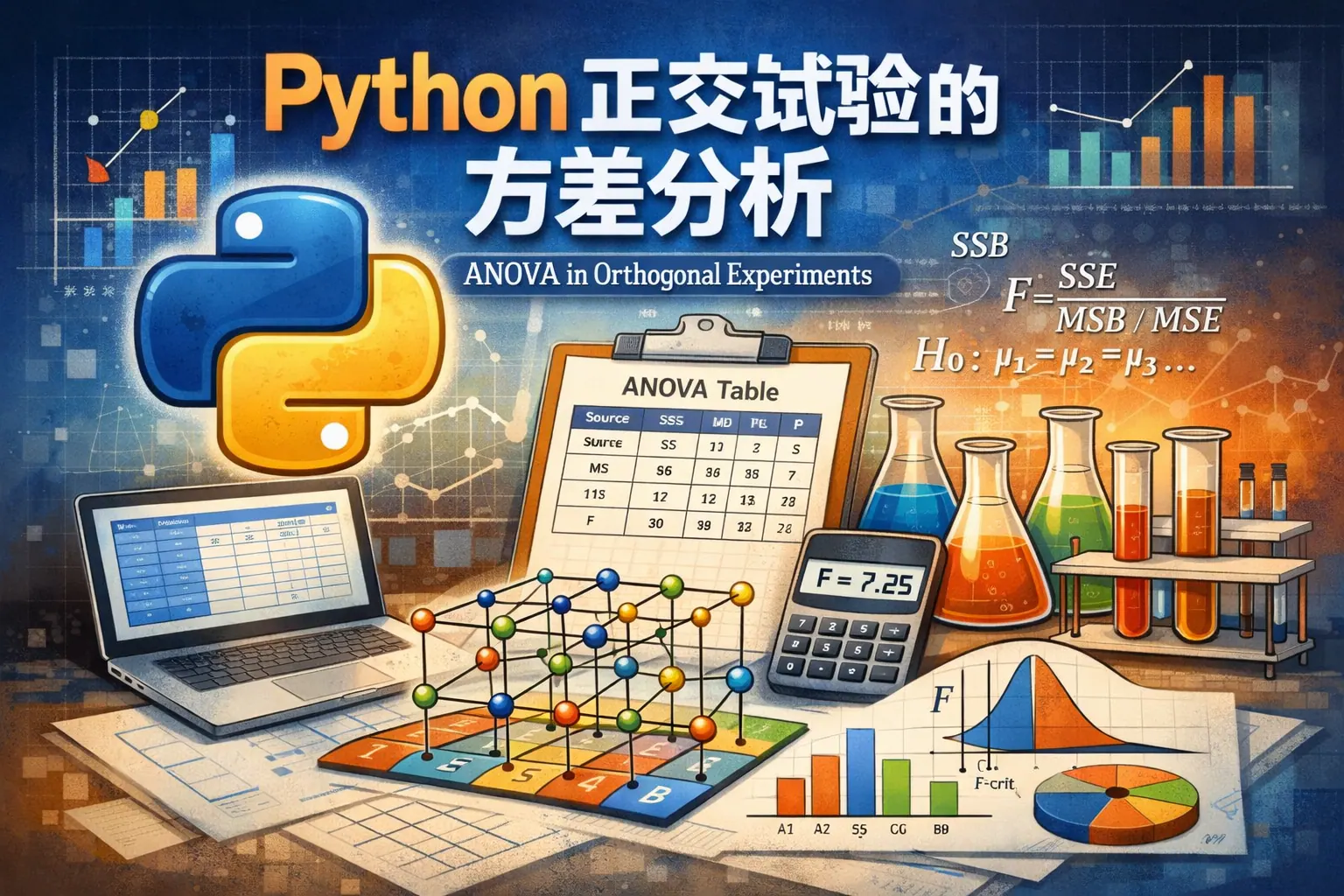

python正交试验的方差分析

Python进行正交试验的方差分析,本质是利用统计建模方法对实验因素的变异进行分解,并通过F检验判断因素显著性。借助pandas与statsmodels等工具,可以高效完成数据整理、模型建立与显著性分析,适用于多因素实验优化场景。理解平方和分解、F值与p值意义,并结合交互效应与模型假设检验,是确保正交试验分析准确性的关键。未来发展将更加自动化与智能化。

Joshua Lee

Joshua Lee- 2026-03-29

python模拟钟表的实验目的

Python模拟钟表实验的核心目的在于通过时间建模、图形绘制与算法实现,培养学习者的编程逻辑、面向对象思维和可视化开发能力。实验结合循环结构、事件驱动机制与数学计算,使学生能够将抽象时间概念转化为程序模型,在实践中理解系统设计与动态更新原理,同时提升综合应用与创新拓展能力。通过这一实验,理论知识与实际编程能力实现有效融合。

William Gu

William Gu- 2026-03-28

人工智能如何做实验的

人工智能做实验的核心是将“假设—设计—执行—分析—迭代”转化为自动闭环,借助实验设计与贝叶斯优化提升样本效率,通过机器人与LIMS实现标准化采集,以数字孪生加速虚拟验证,并以统计评估、版本化与审计保障可重复性与合规。选型上先用DoE建立全局,再以主动学习或强化学习精细优化,配合安全约束与仿真校准管理sim2real差距。组织层面需平台化数据管线、方法论模板与治理体系,未来将走向多智能体协作与跨尺度仿真的一体化研发平台。

Joshua Lee

Joshua Lee- 2026-01-17

人工智能如何去做实验的

人工智能做实验的路径是以证据为核心的闭环:明确目标与因果假设,选择合适的实验设计(A/B测试、准实验、仿真与数字孪生、自动化实验室),在严格的数据治理与可重复性保障下自动化执行,并用贝叶斯优化、强化学习与因果推断提升效率与外推性。在线业务通过自适应分流和护栏指标降低风险,工业场景用虚拟试验安全加速迭代,生命科学借助高通量自动化实现更快发现。结合国内外平台的中性选型与合规实践,组织可建立统一度量与开放工具链,把AI实验沉淀为可审计、可复用的长期能力,未来将向自主、可解释与更强合规演进。

William Gu

William Gu- 2026-01-17

人工智能如何做实验

本文系统回答了人工智能如何做实验:以假设—数据—指标—运行—迭代为主线,先明确业务与科学目标与边界,再用因果推断与统计功效设计离线与在线实验;以数据治理与多维评估保障可重复、可解释与公平;通过MLOps平台完成实验追踪、自动化与合规审计,并以成本—效果分析优化资源分配;在国内与国外平台中选择匹配治理与工程能力的组合,最终以标准化流程与实验文化实现规模化与持续迭代。

Joshua Lee

Joshua Lee- 2026-01-17

如何测试大模型的推理性能

本文系统回答了如何测试大模型的推理性能:以多维框架明确正确性、鲁棒性、可解释性与效率;选用涵盖数学、逻辑、常识与代码的中英文基准并与私有场景映射;采用准确率、pass@k、自一致性、步骤正确率与校准度等指标,并进行显著性与敏感性分析;在固定提示与解码参数的前提下开展A/B与消融实验,严控数据泄露;构建自动化评测流水线,结合人审抽查与失败样本回归;将评测与安全治理、成本与延迟联动,最终以业务指标闭环验证模型的真实可用性与迭代价值。

William Gu

William Gu- 2026-01-16

如何评估大模型的算法

本文提出评估大模型算法的五要素闭环:以业务与安全为目标,构建质量、鲁棒性、效率与成本的指标体系;结合通用基准与私有样本的数据设计;采用自动评测、人类评审与代理评审的混合方法;通过离线到在线的A/B实验验证价值并纳入OEC;配合安全、伦理与合规评测及工程化工具链,形成可复现、可审计、可持续优化的评估体系,确保在真实场景中以可控成本稳定创造价值。

Joshua Lee

Joshua Lee- 2026-01-16

如何测试大模型的能力

本文提出以目标驱动的多层评测体系来测试大模型能力:以业务场景定义成功标准,结合离线基准、场景化任务、人工评审、安全与对齐测试,以及在线A/B与业务指标验证,构建可追溯的闭环。通过统一评测协议、严格数据治理与自动化管线保障可比与可复现;以评分卡整合准确、鲁棒、安全、效率与体验,指导模型迭代与供应商选型。借助红队与回归测试持续刷新难例库,平衡成本与SLO,在合规框架下实现稳定上线与持续改进。

William Gu

William Gu- 2026-01-16

如何通过数据与事实验证问题是否真实存在

本文给出以证据链验证问题真伪的系统路径:先把模糊问题转为可证伪假设,预设指标与阈值;再用日志、调研与实验等多源证据交叉验证,并以统计与业务双重显著性决策;最后将验证流程化与工具化,结合治理与合规形成可复核的闭环,并展望因果推断与隐私保护计算等趋势。

Rhett Bai

Rhett Bai- 2026-01-15

如何用python编写实验程序

用 Python 编写实验程序的高效路径是以“配置驱动、可重复性与审计”为核心:先将问题转化为可计算的假设与指标,搭建模块化架构并用虚拟环境或容器锁定依赖;再以 YAML/TOML 与 CLI 统一参数、固定随机种子;构建数据管道与统计分析流程,并用日志、版本控制与实验追踪记录证据链;最后在自动化与持续集成中批量运行与质量保障,使团队协作与跨平台交付都能维持稳定、透明与可复现。

Rhett Bai

Rhett Bai- 2026-01-14

python如何进行对比分析

本文系统回答了在Python中如何开展对比分析:先明确对比对象、指标与最小可检测效应,再以合适的统计或贝叶斯方法进行差异检验,结合效应量与置信区间输出可解释结论;针对观察数据运用匹配、DID与RDD等因果方法,机器学习场景下以交叉验证与配对检验严谨比较模型;全过程强化数据清洗、标准化、多重比较校正与检验功效,配合可视化展示不确定性;最后通过工程化流程、协作与合规保障复现与审计,并在需要时借助项目协作系统如PingCode提升协同效率。

Joshua Lee

Joshua Lee- 2026-01-13

设备指纹怎么做策略灰度?人群分桶、对照组、指标监控

本文系统阐述了用设备指纹开展策略灰度的全流程:通过粘性分桶与分层抽样确保稳定曝光,采用留存对照组与影子模式保障因果识别,并以效果、稳定性与合规三线指标监控构建护栏;配合特性开关、序贯监控与自动回滚实现工程化落地。文章还对国内外方案进行对比,指出在跨平台覆盖、对抗恢复与合规设计上的关键点,并提出样本量、偏差控制与公平性等进阶实践。最后展望隐私增强计算与自适应试验将推动设备指纹灰度更高效更稳健。

William Gu

William Gu- 2026-01-07

如何用python物理实验

本文系统阐述用Python开展物理实验的完整路径:以配置化流程将硬件接入、数据采集、清洗与统计分析、仿真建模、可视化与文档形成可重复的流水线。通过PyVISA、NI-DAQ或LabJack完成仪器控制与采样,借助NumPy、SciPy、pandas与Matplotlib/Plotly实现去噪、拟合、谱分析与互动报告,并以元数据与审计日志保障可追溯与合规。文章给出工具对比表与两个落地案例,强调采样同步、误差传递与闭环控制的要点,并提出协作与治理建议(在跨团队场景可引入PingCode承载需求与变更)。最后展望边缘采样与GPU加速、AI辅助实验设计及更严格数据治理的趋势。

Joshua Lee

Joshua Lee- 2026-01-06