如何用代码制作对联

用代码制作对联的关键在于将字数一致、词性对仗、平仄相对和语义匹配等传统规则转化为可计算的逻辑结构。可以从模板拼接入手,逐步加入词性分析和平仄检测,进一步结合自然语言生成模型提升质量。构建完整系统时应采用模块化架构与评分机制,实现生成与校验结合。未来对联自动生成将向智能化、情境化和教育化方向发展,成为语言技术与传统文化融合的重要应用场景。

William Gu

William Gu- 2026-04-07

python如何编写对联代码

Python 编写对联代码可以通过规则匹配、词性标注、平仄判断以及语言模型生成等方式实现。初学者可用简单字数与替换规则构建基础对联程序,进阶可结合中文分词与词性分析优化结构,再通过拼音库实现平仄校验,提升对仗专业性。若追求更自然表达,可利用预训练语言模型生成下联,并通过语义与规则双重筛选优化结果。未来对联生成将结合大模型与知识结构,向更智能与可解释方向发展。

William Gu

William Gu- 2026-04-07

词向量代码如何构建

词向量代码构建的核心在于将文本词语映射为可计算的连续向量,通过统计方法或神经网络模型学习语义关系。实现过程通常包括数据预处理、词表构建、训练样本生成、模型训练与评估优化。常见方法如Word2Vec、GloVe及深度学习框架中的Embedding层,各有适用场景。掌握完整构建流程与优化策略,是开展自然语言处理任务的重要基础能力。

Rhett Bai

Rhett Bai- 2026-04-01

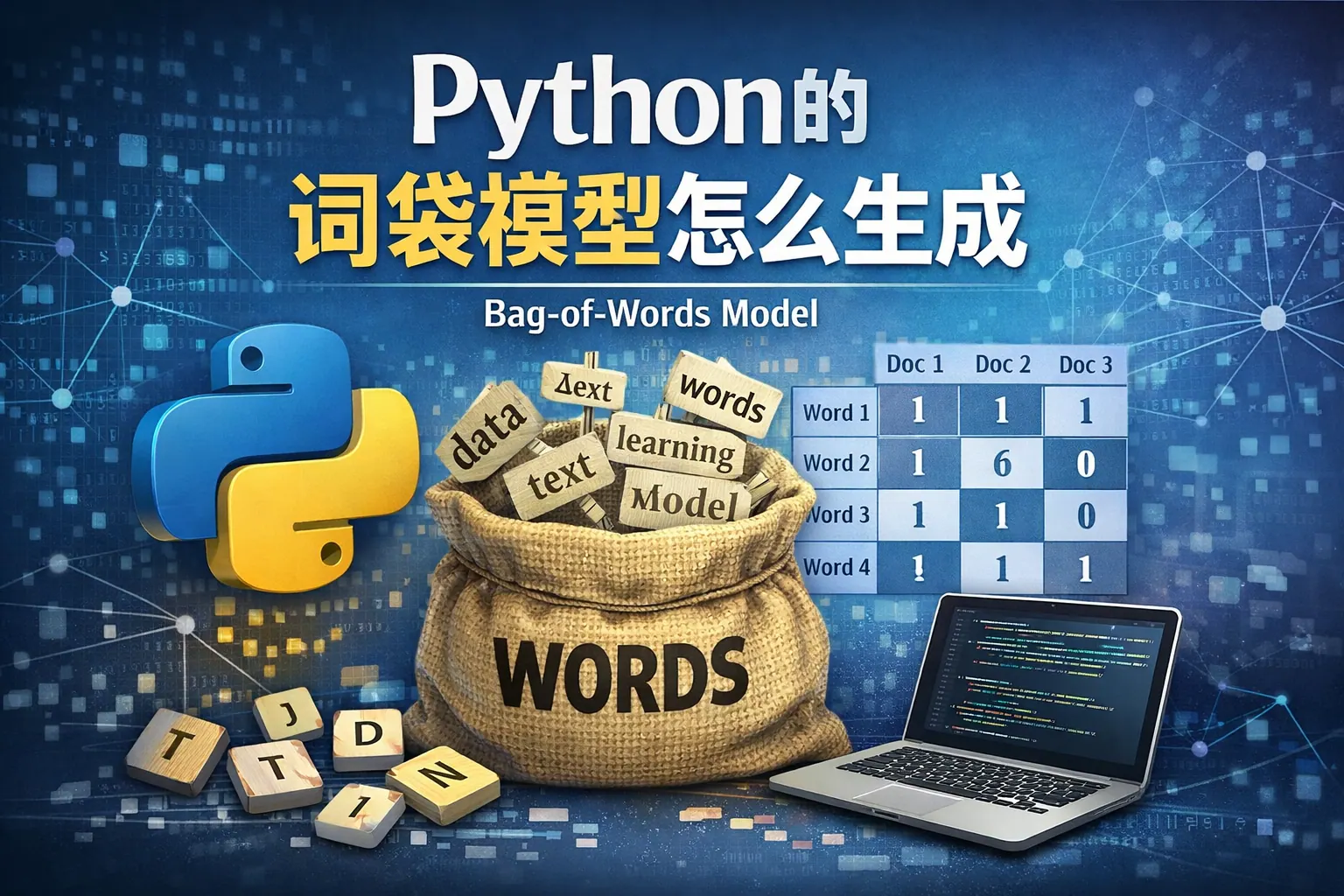

python的词袋模型怎么生成

本文系统讲解了 Python 中词袋模型的生成方法与应用逻辑,从基础原理出发,依次介绍了原生 Python 实现、scikit-learn 工具使用、中文文本处理要点以及关键参数对效果的影响。文章通过对比词袋模型与 TF-IDF 的差异,说明了不同文本表示方式在实际项目中的适用场景,并结合 SEO 与信息架构视角,分析了词袋模型在内容分析与优化中的实践价值。整体强调了词袋模型在可解释性、工程稳定性和基础特征构建方面的长期意义。

Rhett Bai

Rhett Bai- 2026-03-29

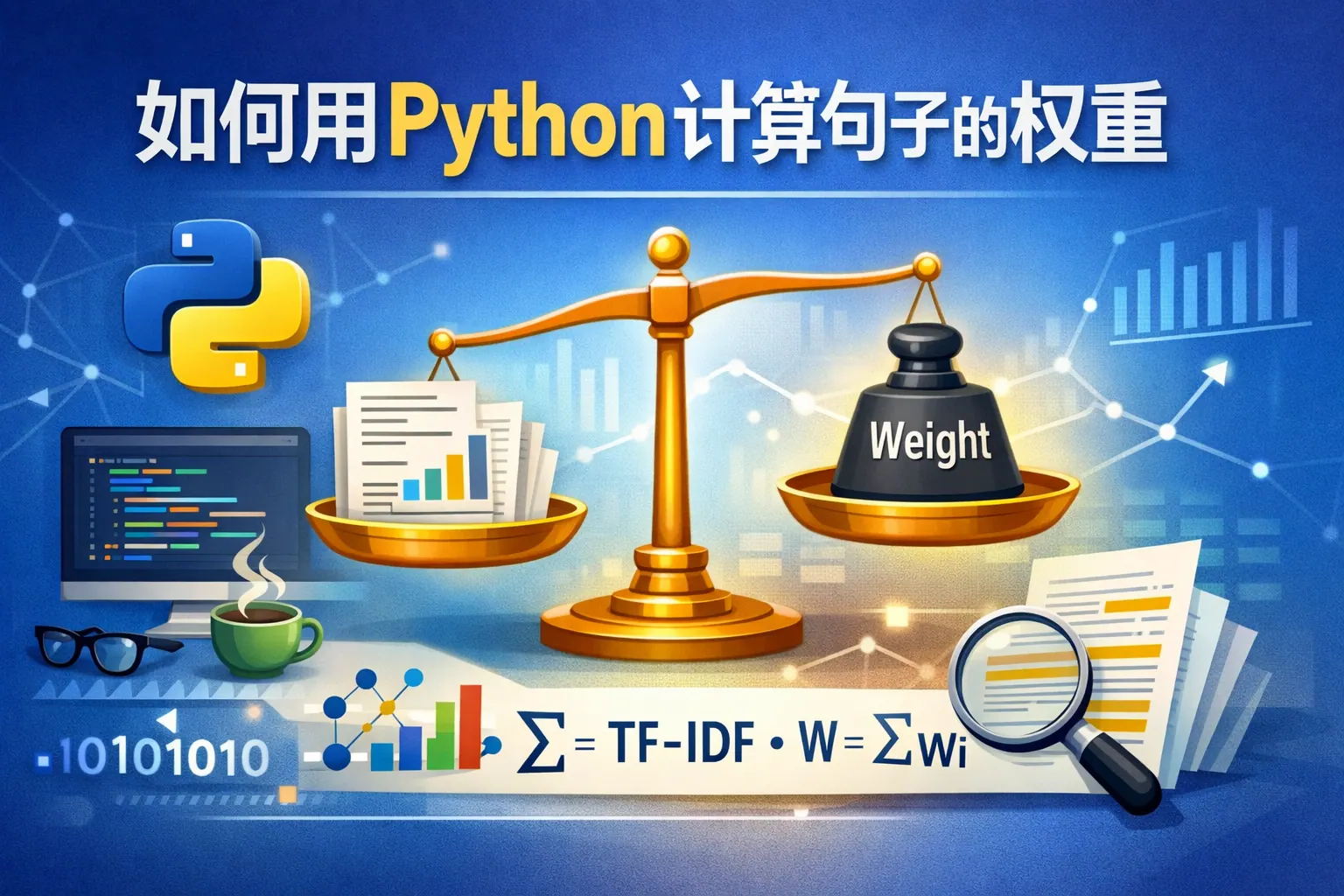

如何用python计算句子的权重

本文系统讲解了如何使用 Python 计算句子的权重,从基础的词频统计方法到基于图模型和深度学习的语义表示进行了完整梳理。文章指出,句子权重的本质是对信息重要性的量化,不同算法在可解释性、语义理解能力和计算成本上存在显著差异。通过对 TF-IDF、TextRank 以及语义向量方法的对比分析,强调应结合具体应用场景选择合适方案,并在实践中通过评估与优化不断调整,以获得更可靠的权重结果。

Joshua Lee

Joshua Lee- 2026-03-28

基于规则的词性标注python

基于规则的词性标注是一种依靠词典、上下文规则和正则表达式实现的自然语言处理方法,在 Python 中可以通过构建分层规则系统高效实现。该方法具有可解释性强、无需大量标注数据、适用于低资源语言和专业领域文本等优势,但在复杂语境和泛化能力方面存在局限。通过引入上下文窗口与错误驱动优化机制,可以显著提升标注准确率。未来趋势是规则与统计模型融合,在保证可控性的同时增强性能表现。

Elara

Elara- 2026-03-28

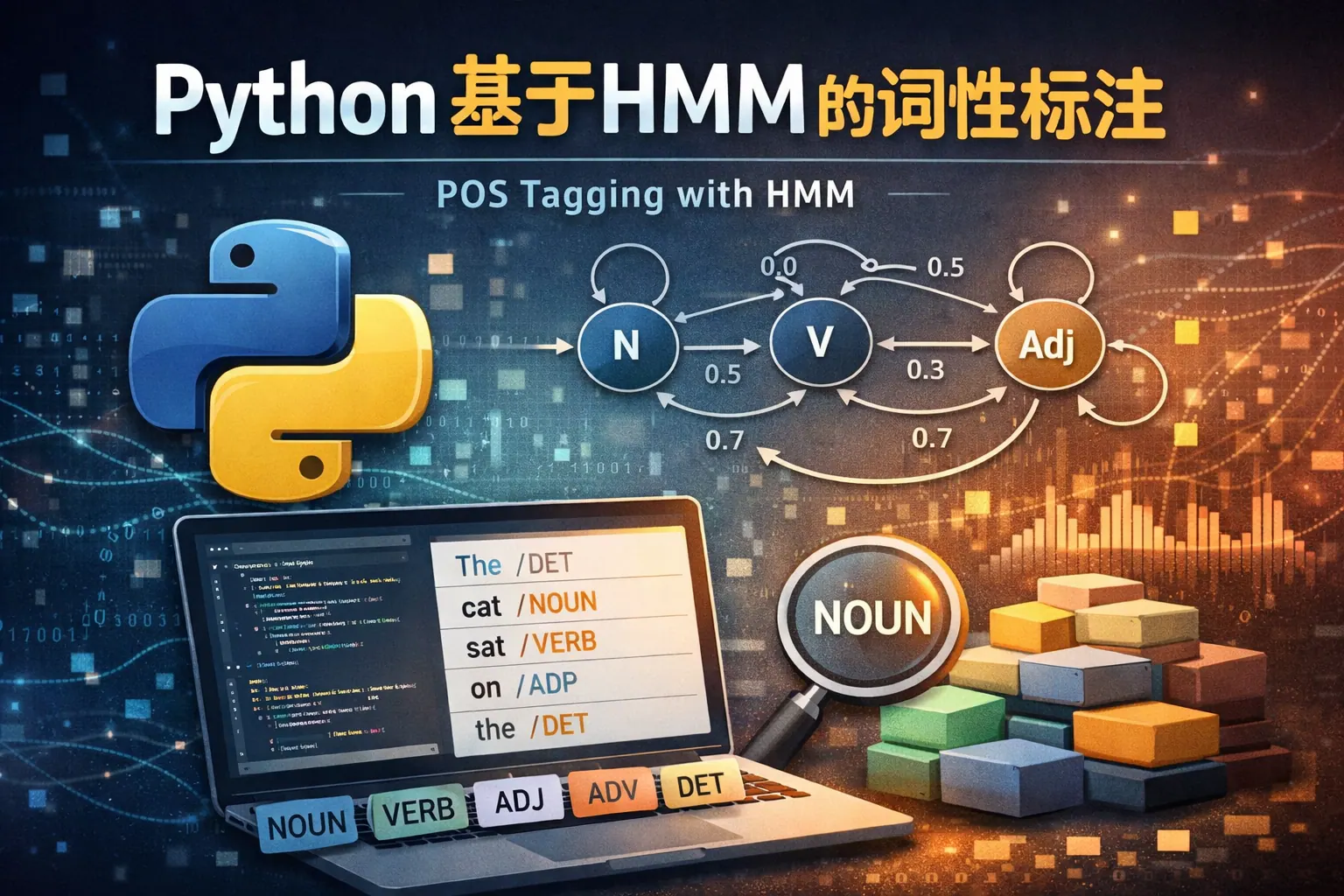

python基于hmm的词性标注

本文系统讲解了 Python 环境下基于隐马尔可夫模型的词性标注方法,从问题背景、数学建模、概率估计到维特比解码与工程实现进行了完整梳理。文章指出,HMM 通过转移概率与发射概率刻画词性与词语关系,在中小规模语料和资源受限场景中仍具备稳定、可解释的优势。结合方法对比与实践建议,内容强调了 HMM 在教学、原型验证和可解释自然语言处理中的长期价值与应用前景。

Rhett Bai

Rhett Bai- 2026-03-28

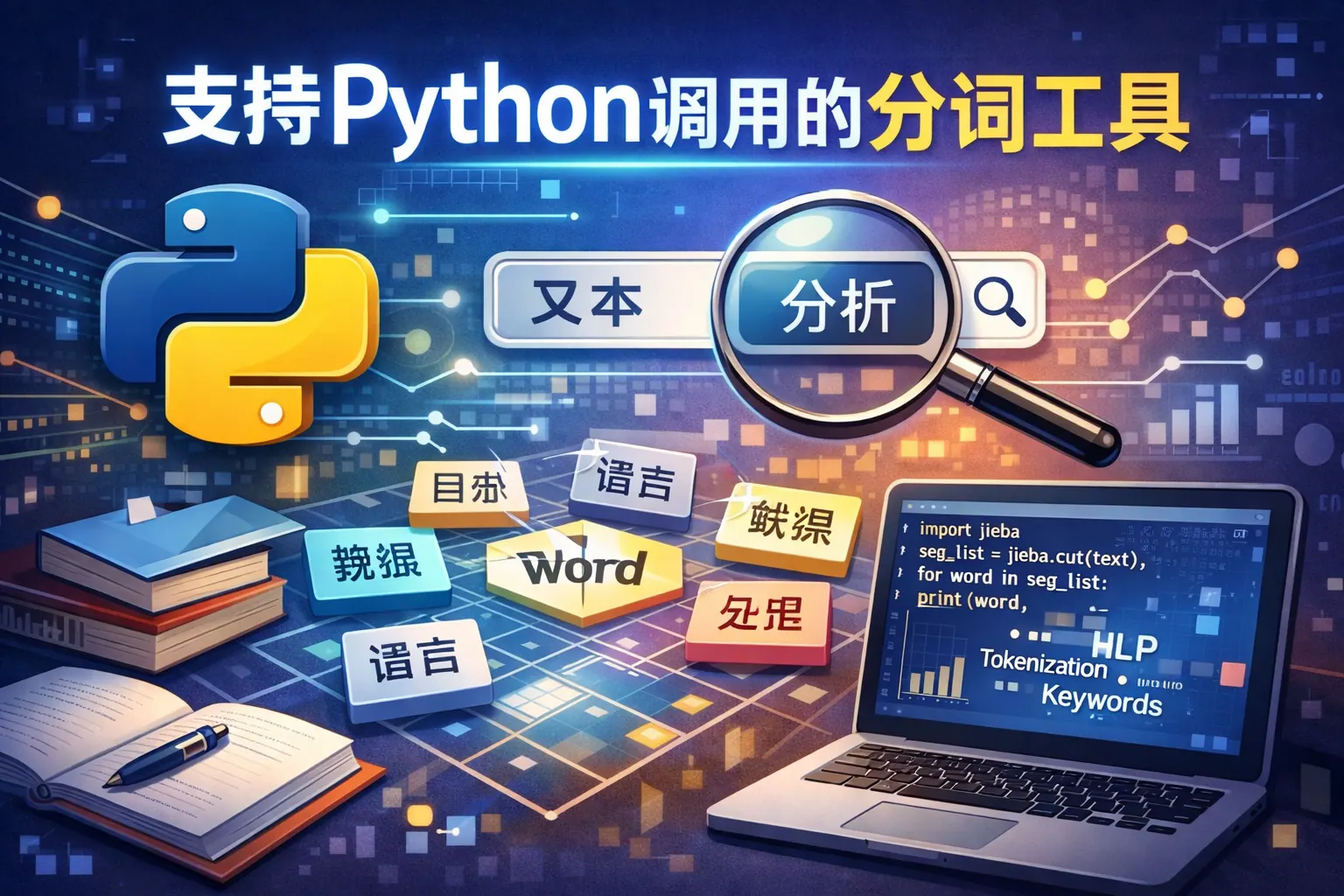

支持python调用的分词工具

支持Python调用的分词工具种类丰富,包括轻量级规则分词、统计模型分词以及基于深度学习的分词框架。常见工具如Jieba、THULAC、pkuseg、HanLP、SpaCy与NLTK各具优势,适用于不同语言环境与业务场景。在选择分词工具时,应综合考虑文本类型、准确率要求、运行性能与生态兼容性。未来分词技术将与预训练语言模型深度融合,在搜索优化、内容推荐与语义理解领域发挥更重要作用。

Joshua Lee

Joshua Lee- 2026-03-28

python中rouge的使用

本文系统讲解了Python中ROUGE的原理、指标体系及实际使用方法,重点介绍了rouge-score与evaluate两种主流实现方式,并通过代码示例演示具体用法。同时分析了中文文本分词处理、多参考文本评估、与其他指标对比等关键问题,指出ROUGE适用于摘要和生成任务的自动评测,但需结合语义指标提升评估全面性。最后总结了最佳实践与未来趋势,帮助读者在实际项目中正确、高效地应用ROUGE进行文本质量评估。

Joshua Lee

Joshua Lee- 2026-03-28

python中的phonemizet

本文系统解析了在 Python 中实现音素化的主流方法,重点介绍了 Phonemizer 库及其结合 eSpeak、Festival、CMU 词典等后端引擎的实现方式,深入对比不同方案在语言支持、输出格式与适用场景方面的差异。同时分析了音素化在语音合成、语音识别与发音评测中的关键作用,并探讨了多语言场景下的挑战与性能优化策略。文章最后结合行业发展趋势,指出规则驱动与神经网络 G2P 模型融合将成为未来音素化技术的重要方向。

Elara

Elara- 2026-03-28

Python的morphology

Python中的morphology主要涵盖图像形态学与自然语言形态分析两大方向,其中以图像处理应用最为广泛。通过腐蚀、膨胀、开闭运算等方法,形态学能够有效实现去噪、目标提取与结构增强,在工业视觉、医学影像和文本识别等场景具有重要价值。同时,在自然语言处理中,形态分析用于词形变化与语法结构识别。随着深度学习的发展,形态学方法正与神经网络融合,持续发挥基础性作用。

Elara

Elara- 2026-03-28

python怎么去掉停用词

Python去掉停用词通常通过分词后加载停用词表进行过滤实现,英文可使用NLTK或spaCy内置停用词功能,中文则常结合jieba与自定义词表完成。不同方法在性能与扩展性上各有差异,应根据任务目标选择合适方案,并注意在情感分析或深度学习场景下谨慎删除关键功能词。合理的停用词策略能够显著提升文本分析质量与建模效果。

Elara

Elara- 2026-03-25

python怎么调用停词库

Python调用停词库主要有四种方式:使用NLTK内置停词表、spaCy语言模型停词集、scikit-learn内置英文停词,以及加载自定义停词文件。不同方法适用于不同场景,科研适合NLTK,工程项目推荐spaCy,机器学习建模可直接使用向量化工具内置停词,中文处理通常结合分词工具与本地停词表。合理使用停词库能够提升文本分析、信息检索与模型训练效果,但需根据具体任务调整停词策略。

William Gu

William Gu- 2026-03-25

python怎么识别主谓宾

Python识别主谓宾结构主要依赖依存句法分析技术,通过识别nsubj和dobj等依存关系标签抽取主语、谓语和宾语。英文场景常用spaCy,中文场景常用HanLP,结合Universal Dependencies标签体系可实现跨语言处理。复杂句和被动语态需要额外规则优化。该技术广泛应用于信息抽取、知识图谱和智能问答系统,未来将与大模型深度融合,提高语义理解能力和跨语言泛化能力。

Rhett Bai

Rhett Bai- 2026-03-25

结巴分词python怎么下载

下载结巴分词Python版本最简单的方法是使用pip命令在线安装,只需在命令行输入pip install jieba即可完成部署;在无网络环境下,也可通过官网下载源码包或whl文件进行离线安装。安装完成后通过简单代码即可验证是否成功。文章系统介绍了在线与离线下载方法、常见问题解决方案以及不同Python版本的兼容情况,帮助开发者快速搭建中文分词环境。

William Gu

William Gu- 2026-03-25

python结巴库怎么下载

下载Python结巴库最直接的方法是使用pip install jieba命令进行在线安装,如网络较慢可使用国内镜像源加速,若服务器无法联网则可通过下载源码包进行离线安装。安装后可通过import jieba进行测试,并建议在虚拟环境中管理依赖以避免版本冲突。结巴分词作为常用中文分词工具,适用于文本分析、搜索优化等场景,部署简单、扩展性强,是自然语言处理入门的重要工具。

Rhett Bai

Rhett Bai- 2026-03-25

python 分词后怎么词频

Python 分词后统计词频的核心方法是将分词结果转为列表,再通过字典或 collections.Counter 进行频次统计,其中 Counter 是最推荐方式,代码简洁且性能优良。针对中文文本需先借助分词工具处理,并结合停用词过滤与数据清洗提升准确度。若面对大规模数据,可采用逐行读取或分批统计方式优化性能。词频统计不仅是文本分析基础,也是关键词提取与数据决策的重要支撑。

Joshua Lee

Joshua Lee- 2026-03-25

python怎么扩展nlpir系统

Python扩展NLPIR系统的核心在于通过动态库调用实现基础分词功能,再结合Python生态进行封装、词典优化、模型增强与服务化部署。通过模块化设计、行业词典扩展及机器学习协同,可以显著提升分词准确率和系统扩展能力。在未来自然语言处理架构中,NLPIR将作为基础组件,与更复杂的语义模型协同发展。

William Gu

William Gu- 2026-03-25

python中lem怎么使用

在 Python 中使用 LEM(词形还原)主要依赖 NLTK 与 spaCy 等自然语言处理库,通过将不同词形统一为标准形式,提高文本分析与搜索匹配的准确性。相比词干提取,LEM 更强调语义准确性,适用于搜索引擎、情感分析与推荐系统等场景。实际应用中应结合词性标注与完整文本预处理流程,以提升处理效果与系统性能。随着大模型发展,LEM 将与语义向量技术融合,但其基础预处理价值仍将长期存在。

William Gu

William Gu- 2026-03-25

python怎么进行词频分析

Python进行词频分析通常包括文本清洗、分词处理、停用词过滤和词频统计四个核心步骤。可以使用collections.Counter进行高效统计,中文需借助分词工具,进阶场景可结合专业自然语言处理库实现词形还原与语义分析。通过可视化工具还能将结果直观呈现。词频分析不仅是文本处理基础技术,也在搜索优化、数据分析和舆情监测等场景中具有重要应用价值。随着智能化发展,词频统计将与语义理解技术进一步融合。

Joshua Lee

Joshua Lee- 2026-03-25