python 梯度下降的线性回归

常见问答

如何在Python中实现线性回归的梯度下降算法?

我想用Python编写线性回归模型,并利用梯度下降算法来优化参数,具体步骤有哪些?

用Python实现线性回归的梯度下降方法解析

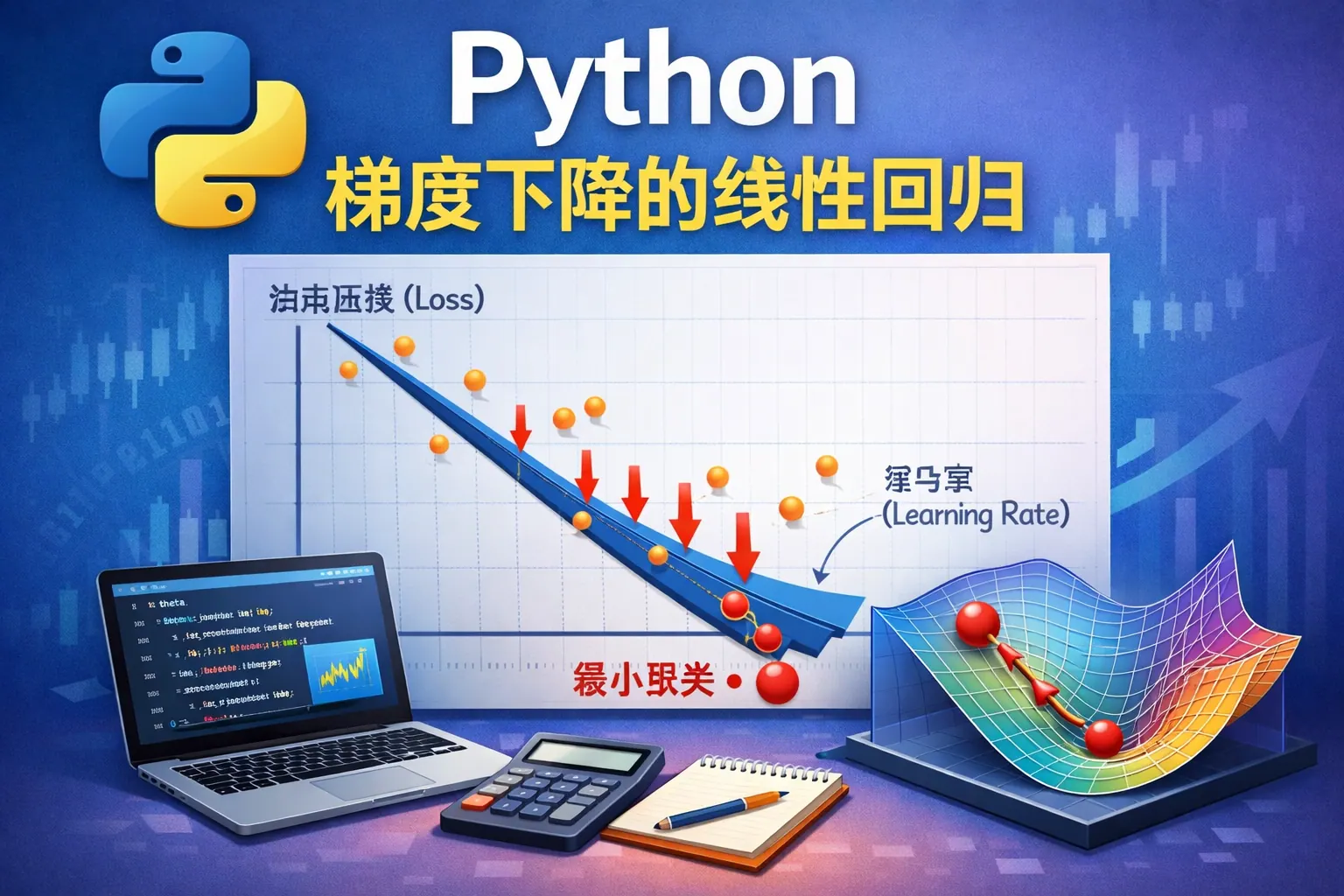

实现梯度下降线性回归主要包括数据准备、参数初始化、计算预测值、计算损失函数、计算梯度和更新参数这几个步骤。先加载数据并对特征作适当处理,初始化权重和偏置,然后循环迭代,根据当前参数计算预测值,接着计算损失(如均方误差),再计算参数的梯度,最后根据学习率更新参数,不断迭代直到损失收敛或达到预设次数。

梯度下降优化线性回归时如何选择学习率?

在使用梯度下降进行线性回归训练时,怎样确定一个合适的学习率以保证模型收敛?

确定梯度下降学习率的实用技巧

学习率太大会导致参数更新过快,可能使损失函数震荡或发散;学习率太小则训练速度极慢。常见做法是从一个较小的学习率开始,如0.01或0.001,观察损失变化趋势。如果损失降低平稳,可稍微增大学习率尝试加快收敛,否则减小学习率。此外,可采用动态调整学习率的方法,比如学习率衰减或者自适应优化算法。

为什么梯度下降在训练线性回归模型中很重要?

梯度下降算法在线性回归模型参数优化中起什么作用?对结果有什么影响?

梯度下降在优化线性回归参数中的关键作用

梯度下降通过计算损失函数对模型参数(权重和偏置)的梯度,指导参数向减少损失的方向更新。这样模型性能不断提升,预测误差逐渐减小。相较于直接求解析解,梯度下降适合处理大规模数据或复杂模型,也方便扩展到其它优化目标。正确使用梯度下降能有效训练出准确的线性回归模型。

* 文章含AI生成内容