Python怎么对单词分词

用户关注问题

Python中有哪些常用的单词分词库?

我想用Python进行单词分词,应该选择哪些库比较合适?它们各自的特点是什么?

常用的Python单词分词库及特点

Python有多个流行的分词库,比如NLTK、spaCy和jieba。NLTK适合教学和研究,支持多种语言的分词。spaCy性能优异,适合实际项目,提供丰富的自然语言处理功能。jieba主要用于中文分词,简单易用。选择时可根据项目需求和语言类型进行决定。

如何用Python实现基本的单词分词功能?

我没有分词经验,想在Python中实现单词分词,有没有简单的demo或者步骤?

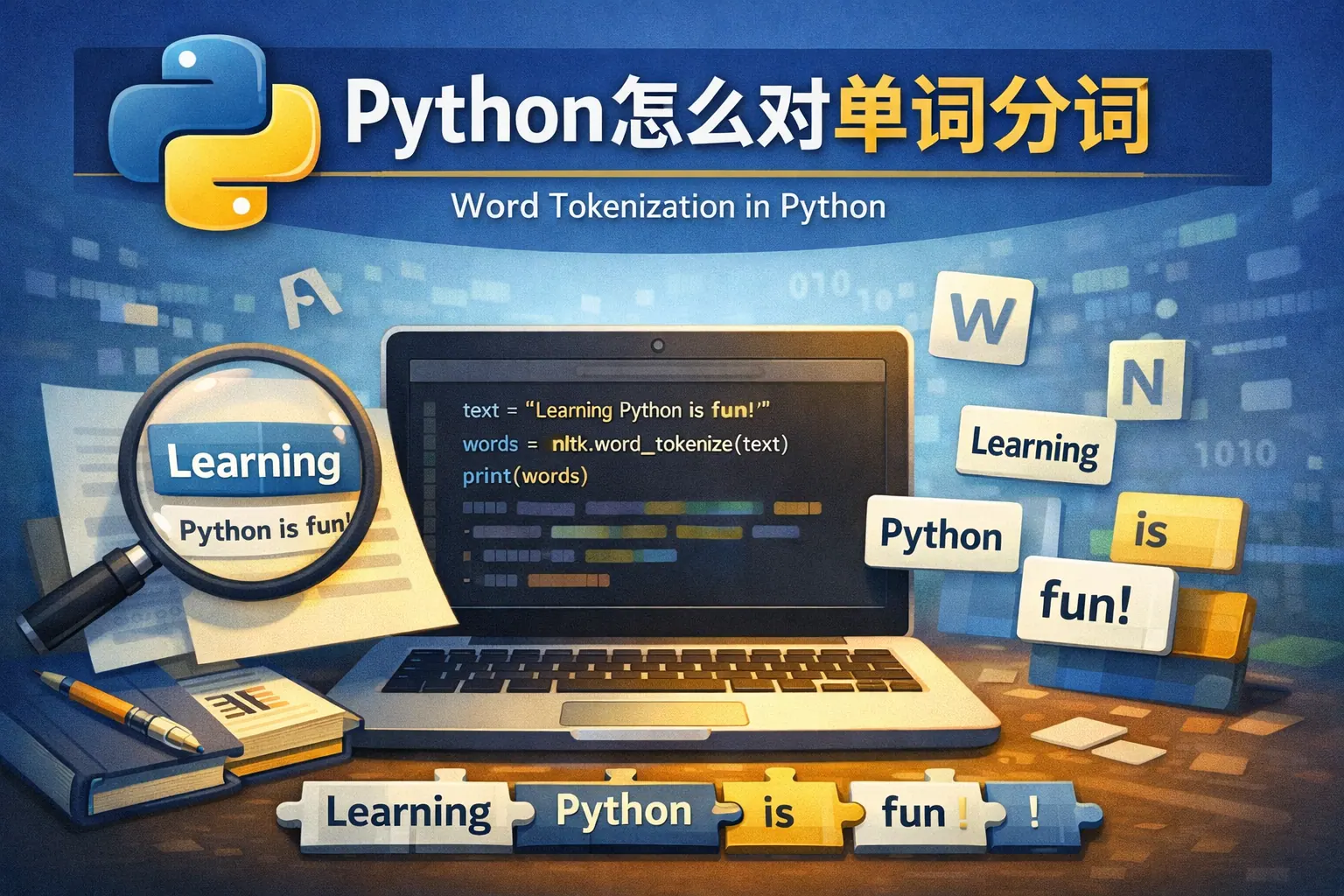

Python实现单词分词的简单示例

可以利用Python内置的字符串操作或者使用NLTK库来实现分词。举例来说,使用NLTK的word_tokenize函数,将文本作为输入,就能得到分词结果。安装NLTK后,通过import nltk和nltk.download('punkt'),调用nltk.word_tokenize(text)即可完成分词。此方法适合英文文本的基本分词需求。

Python单词分词在文本处理中的应用有哪些?

进行单词分词有什么作用,它在自然语言处理中能带来哪些好处?

单词分词在文本处理中的作用和优势

单词分词是文本预处理的重要步骤,能将连续文本拆分为有意义的单词序列,方便后续分析。它有助于词频统计、情感分析、机器翻译和搜索引擎优化。通过分词,计算机能更准确理解文本结构,提高自然语言处理任务的效果。