在过去的40年中,移动电子芯片组的发展路径无疑是朝着日益提高功能集成水平的方向发展,最终形成了系统级芯片(SoC)架构。或是通过单片集成,或是通过高级封装,移动SoC将多种功能(包括但不限于基带、应用处理器、RF收发器、WLAN(Wi-Fi)和WPAN(蓝牙)通信)集成到单个芯片或封装中。对于最终体现现代手机的强大功能但却又轻又薄的结构外形来说,这样的芯片架构是理想的。然而,随着人们超越智能手机,通过AR眼镜作为入口,进入一个全新的增强现实(AR)世界(有人称之为元宇宙)时,SoC架构却被证明不再起推动作用,而逐渐成为一种障碍。

为了将AR眼镜的愿景(双关语)变为现实,设计不仅需要获得大众市场的认可,而且起码还必须能够在日常生活中方便佩戴——作为佩戴者日常着装的一部分。为了实现这一点,这类眼镜需要比智能手机更精简。它们还需要具备时尚的外观。此外,为了最大限度地减少佩戴者的疲劳,这类眼镜必须尽可能轻,而且在重量分布上也要更加平衡,以防止眼镜两侧的重量不均衡。

在过去和目前的设计中,通常都是将电子设备布置在眼镜腿中,这将依然是一个合乎逻辑的地方。然而,移动SoC已无法应对上述挑战,因为除了可能在另一个眼镜腿中增加更大的组件(如电池)之外,实际上其管芯和封装尺寸通常都是单芯片,从而无法实现任何类型的重量均匀/均衡分布。

为了扭转上述趋势,在前不久的骁龙峰会上,高通公司宣布摆脱SoC演进路线,提出了一种分布式架构,这可能会将AR眼镜带入现实。该架构不仅适用于眼镜内部的电子设备,还适用于不同眼镜间的设备和宿主设备,例如智能手机或PC,便于分配一些用于提升手机通信和图形处理方面所需的重量。

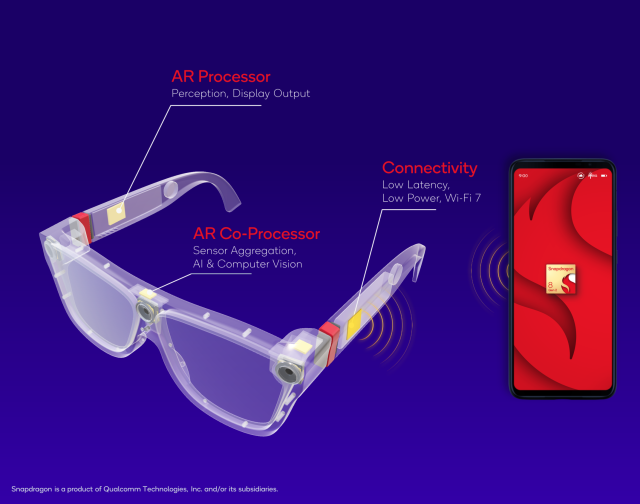

在峰会上,高通宣布了新的骁龙AR2 Gen 1平台。该平台将各类半导体分为围绕眼镜的、能够实现更为精简和平衡设计的三个模块。这些模块包括AR处理器、AR协处理器和Wi-Fi连接模块。

其中,AR处理器将负责图像/视频捕获、计算机视觉和显示驱动等典型的GPU类型功能,不过是通过整合ISP、Adreno视频、AdrenoDisplay和视觉分析引擎IP块,并以硬件加速方式来实现的。

同时,AR协处理器将专注于提供AI加速,以及传感器和相机数据聚合功能,用于像眼睛跟踪、物体检测和生物特征认证等类任务。

最后但也同样重要的是,连通性模块将理所当然地负责分布式架构实现所需的高速、低延迟通信。可能不太显眼的是,该模块使用了高通公司的FastConnect XR 2.0软件套件,不过该公司声称在提供所需性能的同时,功耗比之前的版本降低了40%。

图1:芯片到芯片和AR眼镜到主机的分布式架构。(来源:高通公司)

AR处理器和协处理器与智能手机、PC甚至网络中的主处理器协同工作,以实现分布式计算架构,该架构具有Snapdragon平台固有的异构处理、传感器融合和AI处理能力。连通性模块使用Wi-Fi 7作为高频段,在眼镜和处理主机之间,同时工作的多链路能够提供高达5.8-Gbps的高速/高带宽连接。

与SoC架构的Snapdragon XR2平台相比,Snapdragon AR2 Gen 1平台不仅将平台拆分为多个组件,为AR眼镜提供了更好的重量分布和平衡,还将布线需求减少了45%,印刷电路板(PCB)面积减少了40%,处理器功耗降低了50%,另外,Wi-Fi功耗也降低了40%。因此,所需的空间更小,进一步来说,使得眼镜变得更流畅、更优美、更舒适。

不过,将这种新的分布式架构与现有的SoC解决方案进行比较时,上述的一些减少似乎是不合情理的。

乍一看,布线似乎会随着分布式架构中不同模块间互连的需要而增加,而在SoC中,布线都只是片上互连。实际上,如果这些应用中的布线只是为了实现芯片上不同IP块之间的连接,那将的确如此。然而,在AR眼镜等应用中,无论是SoC还是分布式架构中的多个模块,绝大多数布线都是从外部到芯片的输入/输出(I/O)接口之间的连线。

这些类型的外部组件的实例,包括连接到处理器的传感器和相机。在分布式架构中,这些外部(芯片)组件之间的布线被最少化,因为组件可以放置在与相关模块最近的位置,而不是所有布线都必须连到SoC所在的位置。

当考虑到可能需要为三个模块而不是一个模块供电时,功率降低也似乎违反直觉。但高通公司声称,硬件加速器的广泛使用,以及先进工艺节点技术的使用,确实带来了这些节能效果。

最后,可以认为,此处重量并非一个关键因素,因为就重量或质量而言,即使是此类SoC也相对可以忽略不计。如果仅仅是比较SoC与分布式模块本身,这可能是正确的,包括综合考虑PCB面积和布线的减少也会对重量产生影响。更具体地说,重量分布才会真正对眼镜佩戴者产生影响,特别是在全天佩戴的情况下。

高通公司主AR处理器采用台积电4nm工艺,并针对AR工作负载和要求进行了优化。公司声称,Snapdragon AR2 Gen 1平台在运行功耗低于1W的情况下,可将人工智能处理能力提高2.5倍。该平台的Wi-Fi延迟低于2毫秒,而动作到光子延迟(即用户发出动作到显示器上显示之间的延迟)为9毫秒。这种高速、低延迟的链路使眼镜能够承载分布式架构。如果没有快速的Wi-Fi 7连接,而所有的处理都需要在眼镜上完成的话,将是令人望而却步的,无论是在尺寸和重量,还是美观性和佩戴性方面都是如此。其他一些解决方案可能会在主机和AR眼镜之间使用有线连接,但无线连接在美观性和可穿戴性方面都具有很大的优越性。

分布式设备架构不是一个新概念;大约十年前作者在一个项目中,在设想关于移动设备的未来以及支持移动设备的半导体和网络时,就提出过这种架构。

然而,随着高通公司最新发布的Snapdragon AR2 Gen 1平台,这一概念也被扩展到实际的芯片架构中,并有可能将曾经只是理论上的东西变为增强现实和其他。

(参考原文:Distributed Architecture Puts the ‘Reality’ in AR)

本文为《电子工程专辑》2023年3月刊杂志文章,版权所有,禁止转载。点击申请免费杂志订阅

文章来自:https://www.eet-china.com/